Grad-CAM++原理

和gradcam一样,都基于假设:

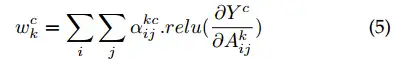

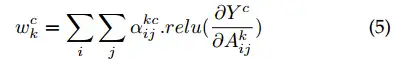

不过gradcam++的权重计算更复杂,涉及三阶导数 假设每个feature map的权重,是由feature每个元素的gradient加权求和而来

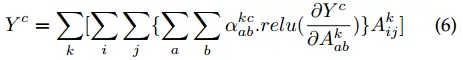

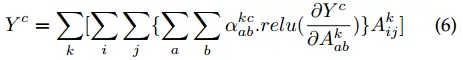

带入第一个公式得到

然后对这个公式左右同时对Aijk求两次导 然后确定Y的形式 指数函数和Softmax

实现用了Softmax tensorflow反传一次即可得到 和gradcam只不同在weight的计算公式

赞赏 微信赞赏

微信赞赏 支付宝赞赏

支付宝赞赏

和gradcam一样,都基于假设:

不过gradcam++的权重计算更复杂,涉及三阶导数 假设每个feature map的权重,是由feature每个元素的gradient加权求和而来

带入第一个公式得到

然后对这个公式左右同时对Aijk求两次导 然后确定Y的形式 指数函数和Softmax

实现用了Softmax tensorflow反传一次即可得到 和gradcam只不同在weight的计算公式

赞赏 微信赞赏

微信赞赏 支付宝赞赏

支付宝赞赏